“Quando comecei isso, pensei que seria tão ruim que não conseguiria enganar ninguém, mas fiquei surpreso”, disse Stevenson, que cofundou o site em 2021, em entrevista. “E não somos sofisticados. Se pudéssemos fazer isso, qualquer pessoa com um orçamento real seria capaz de fazer um trabalho bom o suficiente para que você e eu seríamos enganados. Isso seria assustador.”

tão apertado À medida que as eleições presidenciais de 2024 se aproximam cada vez mais, especialistas e autoridades soam cada vez mais o alarme sobre o poder potencialmente devastador dos deepfakes de IA, alertando que irão corroer ainda mais o sentido de verdade da nação. Temem que isso possa desestabilizar os eleitores.

Há sinais de que a IA e os medos que a rodeiam já estão a ter impacto na raça. No final do ano passado, o ex-presidente Donald Trump acusou falsamente os criadores de um anúncio que apresentava gafes públicas bem documentadas de comércio ilegal de conteúdo gerado por IA. Enquanto isso, as atuais imagens falsas de Trump e de outros políticos Esta política, concebida para impulsionar e prejudicar a economia, tem sido propagada repetidamente, causando caos em pontos-chave do ciclo eleitoral.

Algumas autoridades agora estão correndo para responder. Nos últimos meses, o Departamento de Justiça de New Hampshire anunciou que estava investigando chamadas automáticas falsificadas com a voz do presidente Biden gerada por IA. O estado de Washington alerta os eleitores para terem cuidado com os deepfakes. Legisladores do Oregon à Flórida aprovaram projetos de lei que restringem o uso dessa tecnologia nas comunicações de campanha.

E no Arizona, um estado-chave no campo de batalha nas eleições de 2024, o principal funcionário eleitoral usou seus próprios deepfakes em treinamento para preparar a equipe para o ataque de falsidades que estava por vir. O exercício inspirou Stevenson e seus colegas da Arizona Agenda. O boletim informativo diário da Agenda do Arizona procura explicar histórias políticas complexas aos seus aproximadamente 10.000 assinantes.

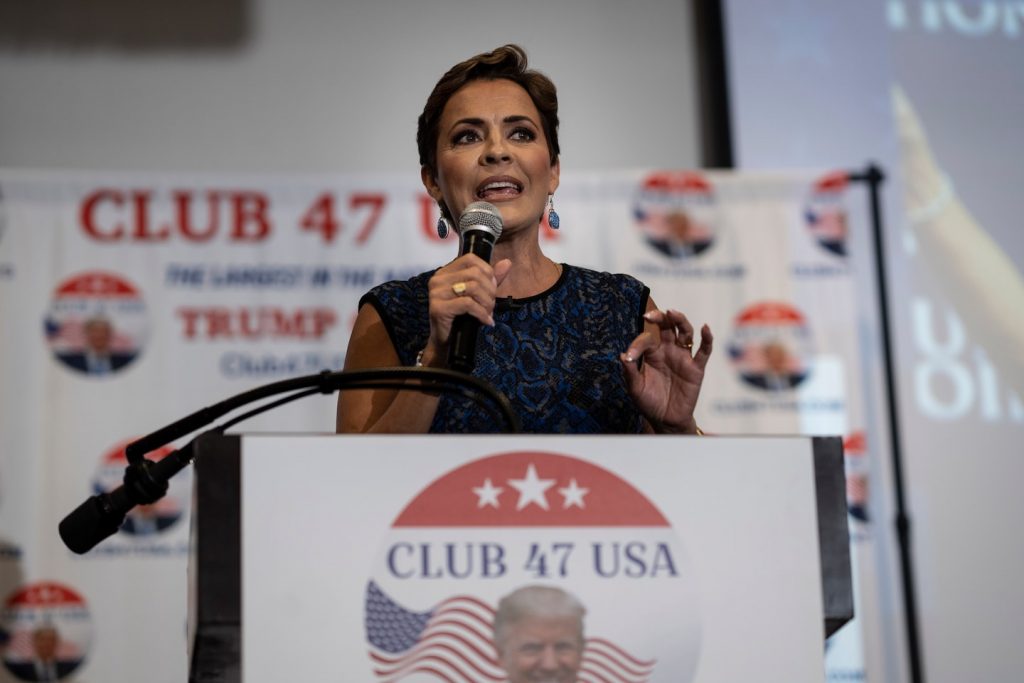

Eles passaram cerca de uma semana debatendo ideias e fizeram uma lista de amigos experientes em tecnologia para ajudar. Na sexta-feira, Stevenson lançou um artigo que incluía três vídeos deepfake de Lake.

Começa com um enredo, contando aos leitores que Lake (um candidato de extrema direita que o Arizona Agenda trollou no passado) decidiu gravar um depoimento sobre o quanto ele gosta do veículo. No entanto, o vídeo vai rapidamente para o final do sorteio.

“Assine a Agenda do Arizona para receber notícias realmente chocantes”, Fake Lake disse à câmera, acrescentando: “E há também as prévias da aterrorizante inteligência artificial chegando às próximas eleições, como este vídeo: um deepfake da Agenda do Arizona projetado para mostrar o quão boa é essa tecnologia.”

No sábado, o vídeo acumulou dezenas de milhares de visualizações, mas recebeu tanta insatisfação do verdadeiro campo de Lake que os advogados de sua campanha enviaram uma carta de cessar e desistir à Agenda do Arizona. A carta exigia que “o referido vídeo deepfake fosse imediatamente removido de todas as plataformas onde foi compartilhado ou divulgado”. A carta diz que a campanha de Lake “buscará todas as soluções legais” se os meios de comunicação não responderem.

Um porta-voz da campanha se recusou a comentar quando contatado no sábado.

Stevenson disse que estava consultando seu advogado sobre como responder, mas na tarde de sábado não tinha planos de remover o vídeo. Deepfakes são um ótimo dispositivo de aprendizagem, diz ele, e espera dar aos leitores as ferramentas para detectar tais falsificações antes que elas cheguem à medida que a temporada eleitoral esquenta.

“Durante este ciclo eleitoral, cabe a todos nós combater esta nova onda de desinformação tecnológica”, disse Stevenson num artigo anexado ao vídeo. “A melhor defesa é saber o que está por aí e usar o pensamento crítico.”

Hany Farid, professor da Universidade da Califórnia, Berkeley, que estuda propaganda digital e desinformação, disse que o vídeo da Agenda do Arizona foi um anúncio útil de serviço público, cuidadosamente elaborado para limitar consequências não intencionais. Ainda assim, ele disse que as organizações de notícias deveriam ter cuidado sobre como enquadram a cobertura deepfake.

“Apoio o PSA, mas é equilibrado”, disse Farid. “Não queremos que nossos leitores e telespectadores presumam que qualquer coisa que não esteja alinhada com sua visão de mundo é falsa”.

Farid disse que existem dois “vetores de ameaça” diferentes para deepfakes. Primeiro, atores mal-intencionados podem gerar vídeos falsos de pessoas dizendo coisas que na verdade não dizem. Em segundo lugar, é mais provável que as pessoas considerem falsas imagens autênticas, embaraçosas ou incriminatórias.

Farid disse que esta dinâmica ficou especialmente evidente durante a invasão da Ucrânia pela Rússia, durante um conflito onde a desinformação é galopante. No início da guerra, a Ucrânia promoveu deepfakes mostrando Paris sob ataque, levando os líderes mundiais a reagir aos ataques do Kremlin com a mesma urgência que reagiriam se a Torre Eiffel fosse alvo.

Farid disse que esta era uma mensagem forte, mas também abriu a porta às alegações infundadas da Rússia de que vídeos subsequentes da Ucrânia mostrando provas de crimes de guerra do Kremlin foram igualmente fabricados.

“Estou preocupado que tudo esteja em dúvida”, disse ele.

O quintal de Stevenson, que recentemente se tornou um campo de batalha política que se tornou um caldeirão de teorias conspiratórias e falsas alegações, tem temores semelhantes.

“Há anos que lutamos pelo que é verdade”, diz ele. “Embora fatos objetivos possam ser ignorados como notícias falsas, vídeos objetivos agora serão ignorados, pois deepfakes e deepfakes serão tratados como realidade.”

Pesquisadores como Farid estão trabalhando arduamente no desenvolvimento de software que tornará mais fácil para jornalistas e outras pessoas detectarem deepfakes. Farid disse que o conjunto de ferramentas atualmente em uso facilita a classificação dos vídeos do Arizona Agenda como falsos, um sinal de esperança contra futuras inundações de falsificações. No entanto, a tecnologia deepfake está avançando rapidamente e poderá se tornar muito mais difícil detectar falsificações no futuro.

E até mesmo os deepfakes reconhecidamente abaixo da média de Stevenson conseguiram enganar algumas pessoas. Um pequeno número de leitores pagantes cancelou a assinatura do boletim informativo de sexta-feira depois que ele publicou a manchete “Kali Lake nos torna sólidos”. Talvez eles pensassem que o apoio de Lake era genuíno, suspeita Stevenson.

Megan Vasquez contribuiu para este relatório.