Na semana passada, inadvertidamente me encontrei no ritmo de asiáticos gerado por IA. Na quarta-feira passada, descobrimos que o gerador de imagens de IA do Meta integrado às mensagens do Instagram falhou completamente em criar imagens de um homem asiático e uma mulher branca usando prompts comuns. Em vez disso, a raça da mulher foi sempre alterada para asiática.

No dia seguinte, tentei o mesmo prompt novamente e descobri que a meta parecia estar bloqueando prompts com palavras-chave como “homem asiático” e “homem afro-americano”. Imediatamente após perguntar ao Meta sobre isso, as imagens voltaram a ficar disponíveis, mas a questão da troca de corrida do dia anterior ainda permanecia.

Eu sei que você está um pouco cansado de ler meus artigos sobre esse fenômeno. Escrever três histórias sobre isso pode ser um pouco demais. Eu particularmente não gosto de ter dezenas de capturas de tela de asiáticos sintéticos no meu telefone.

Mas há algo estranho Aqui, alguns geradores de imagens de IA têm dificuldade especial em emparelhar homens asiáticos e mulheres brancas. É a notícia mais importante do dia? Nunca está longe. Mas as empresas que apregoam ao público que “a IA está a permitir novas formas de ligação e expressão” também estão dispostas a fornecer explicações quando os seus sistemas não conseguem lidar com consultas entre raças.

Após cada história, os leitores compartilharam seus resultados com outros modelos usando instruções semelhantes. Eu não estava sozinho em minha experiência. Foi relatado que mensagens de erro semelhantes foram exibidas e o modelo de IA trocava constantemente de corrida.

se uniu a A beiraEmilia David, da empresa, gera asiáticos de IA em múltiplas plataformas. Os resultados só podem ser descritos como consistentemente contraditórios.

Google Gêmeos

Captura de tela: Emilia David / The Verge

Gêmeos recusou-se a produzir homens asiáticos, mulheres brancas ou humanos de qualquer espécie.

No final de fevereiro, o Google suspendeu sua capacidade de gerar imagens de pessoas de Gêmeos depois que seus pares vomitaram imagens de nazistas racialmente diversos. Esta parece ter sido uma tentativa equivocada de representação diversificada na mídia. O pessoal da geração de imagens de Gêmeos deveria voltar em março, mas aparentemente ainda estão offline.

No entanto, Gêmeos pode produzir imagens sem a presença de uma pessoa.

O Google não respondeu a um pedido de comentário.

Darui

O DALL-E 3 do ChatGPT lutou com a pergunta: “Você pode tirar uma foto de um homem asiático e uma mulher branca?”Não foi isso mesmo Foi um fracasso, mas não um sucesso total. Claro, raça é uma construção social, mas digamos apenas que esta imagem não é o que você esperava.

OpenAI não respondeu a um pedido de comentário.

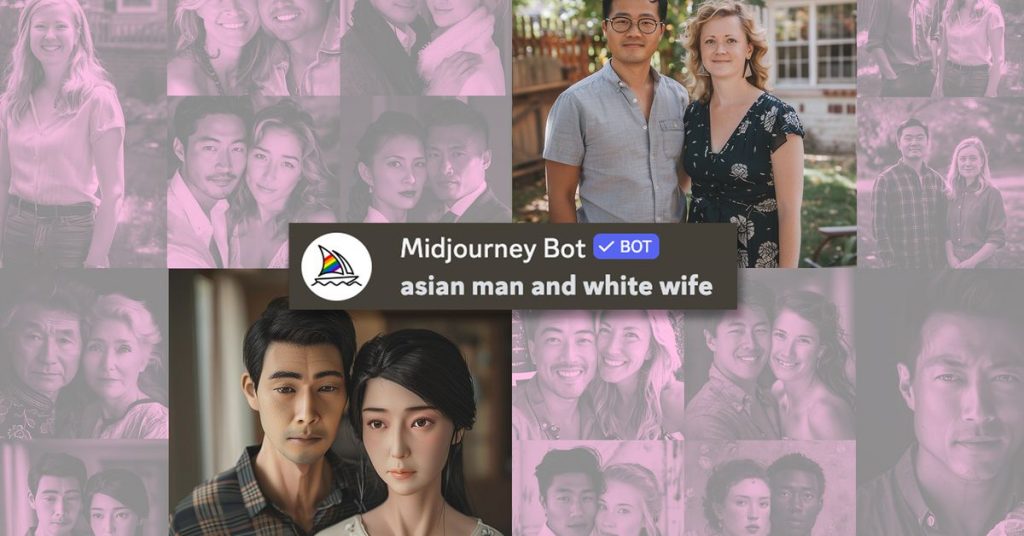

No meio de uma jornada

O meio da jornada também teve dificuldades. Novamente, não foi um fracasso completo como o gerador de imagens do Meta da semana passada, mas claramente teve dificuldades com a alocação e produziu resultados muito confusos. Por exemplo, ninguém consegue explicar a última imagem. A seguir estavam todas as respostas à resposta imediata: “Homem asiático e esposa branca”.

Imagem: Emilia David/The Verge

Imagem: Cass Virginia/The Verge

No final das contas, Midjourney nos forneceu algumas imagens que são a melhor tentativa de representar as relações entre mulheres brancas e homens asiáticos em três plataformas diferentes: Meta, DALL-E e Midjourney. Finalmente, as normas sociais racistas foram destruídas!

Infelizmente, chegamos lá através de uma improvisação: “Um homem asiático e uma mulher branca num ambiente acadêmico em um jardim”.

Imagem: Emilia David/The Verge

O que significa que a maneira mais consistente pela qual uma IA pode considerar esse par inter-racial específico é colocá-lo em um contexto acadêmico? O que o conjunto de treinamento continha para chegar a esse ponto? Temos um preconceito embutido? Por quanto tempo temos que resistir a contar piadas muito banais sobre namoro na NYU?

Midjourney não respondeu aos pedidos de comentários.

Meta AI via Instagram (de novo)

De volta às antigas lutas de tentar fazer com que o gerador de imagens do Instagram reconhecesse mulheres brancas e homens não-brancos!Parece que ele está aparecendo muitos Solicitações como “Mulher branca e marido asiático” ou “Homem asiático-americano e amigo branco” eram melhores. O mesmo erro que encontrei na semana passada não se repetiu.

Mas atualmente está lutando para gerar mensagens de texto como “Homem negro e namorada branca” ou imagens de duas pessoas negras. Acho que provavelmente é mais correto usar “mulher branca e marido negro”, então provavelmente é tudo. às vezes Não consegue ver a renda?

Captura de tela: Mia Sato / The Verge

Existem certos pontos que ficam mais claros quanto mais imagens você gera. Alguns acham isso benigno, como o fato de que muitas mulheres com IA de todas as raças parecem usar os mesmos vestidos florais brancos sem mangas que se cruzam no busto. Geralmente há flores ao redor do casal (os namorados asiáticos costumam comer com flores de cerejeira), e ninguém parece ter mais de 35 anos. Outros padrões na imagem parecem mais óbvios. Todos são retratados como magros, especialmente os homens negros, que são retratados como musculosos. As mulheres brancas são loiras ou ruivas, raramente morenas. Os homens negros sempre tiveram a pele mais escura.

“Como dissemos quando anunciamos esses novos recursos em setembro, esta é uma tecnologia nova e nem sempre será perfeita. Isso é comum a todos os sistemas generativos de IA”, disse o porta-voz da Meta, o deputado Tracy Clayton. A beira no correio. “Desde o lançamento, lançamos continuamente atualizações e melhorias no modelo e continuamos trabalhando para torná-lo ainda melhor.”

Espero poder lhe dar uma visão profunda aqui. Mas, mais uma vez, gostaria de salientar o quão ridículo é que esses sistemas lutem com instruções muito simples que não dependem de estereótipos ou não conseguem criar algo juntos. Em vez de explicar qual é o problema, houve silêncio no rádio e generalizações por parte das empresas. Pedimos desculpas a todos que estavam preocupados com este assunto. Vou voltar ao meu trabalho normal agora.