À medida que o conteúdo gerado pela IA prolifera on-line e sobrecarrega os feeds das redes sociais, as imagens que evocam o efeito do vale misterioso – cenas surreais, como dedos extras ou palavras sem sentido em cenas relativamente comuns – estão se tornando cada vez mais comuns. Você deve ter notado que mais imagens incluem detalhes.

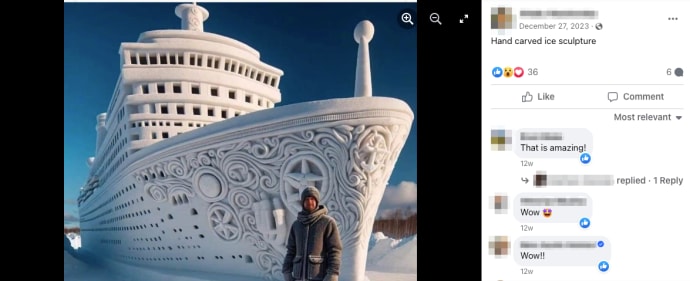

Entre essas postagens enganosas, os usuários jovens encontraram algumas imagens claramente falsas (por exemplo, cachorro de esqui e criança, uma misteriosa escultura de gelo “esculpida à mão” e um gato gigante de crochê). Mas a arte criada pela IA não é óbvia para todos. Usuários mais velhos, que geralmente pertencem à Geração X e acima, caindo Isso ocorre porque esses recursos visuais são postados de uma só vez nas redes sociais. Não é apenas um vídeo do TikTok ou uma rápida olhada na atividade da sua mãe no Facebook que prova isso, há dados por trás disso.

À medida que os usuários mais jovens se dedicam a aplicativos mais chamativos como o TikTok e o Instagram, a plataforma se torna cada vez mais popular entre os adultos mais velhos para encontrar entretenimento e companhia. Recentemente, os algoritmos do Facebook inseriram imagens bizarras de IA nos feeds dos usuários para vender produtos e um grande número de seguidores, de acordo com um artigo pré-impresso publicado em 18 de março por pesquisadores da Universidade de Stanford e da Universidade de Georgetown.

Se você der uma olhada na seção de comentários dessas fotos geradas por IA, você verá usuários mais velhos comentando-as como “lindas” e “incríveis” e muitas vezes adornando essas postagens com emojis de coração e oração. Você pode ver. Por que é que as pessoas mais velhas não só se envolvem com estas páginas, mas também parecem gostar delas?

No momento, os cientistas não têm uma resposta definitiva sobre os efeitos psicológicos da arte da IA. Geradores como DALL-E, Midjourney e Adobe Firefly funcionam em modelos de inteligência artificial treinados em até milhões de imagens, mas não estão disponíveis ao público há 20 anos. Nos últimos dois anos.

Mas os especialistas têm um palpite e a explicação não é tão simples quanto se poderia esperar. Ainda assim, saber por que seu amigo ou parente mais velho está confuso pode fornecer dicas para evitar que sejam vítimas de golpes e desinformação prejudicial.

Por que as imagens de IA enganam os idosos

Decifrar este código é especialmente importante porque empresas tecnológicas como a Google tendem a ignorar os utilizadores mais velhos durante os testes internos, reconhece a Universidade de Toronto, que estuda os efeitos do envelhecimento na comunicação, disse o neurocientista Björn Hellmann ao The Daily Beast.

“Nesses tipos de espaços, muitas vezes as coisas são feitas sem qualquer consideração da perspectiva do envelhecimento”, diz ele.

Embora o declínio cognitivo possa parecer uma explicação razoável para esta discrepância induzida pelas máquinas, as primeiras pesquisas sugerem que a falta de experiência e familiaridade com a IA pode estar a contribuir para a diferença entre os telespectadores mais jovens e os mais velhos. compreensão. Por exemplo, num inquérito AARP/NORC de agosto de 2023 com aproximadamente 1.300 adultos norte-americanos com 50 anos ou mais, apenas 17% dos participantes disseram ter lido ou ouvido “muito” sobre IA.

Até agora, algumas experiências que analisam o reconhecimento da IA em adultos mais velhos parecem ser consistentes com o fenómeno do Facebook.Em um estudo publicado no mês passado na revista relatório científicoDentro, os cientistas mostraram a 201 participantes uma combinação de IA e imagens geradas por humanos e avaliaram suas respostas com base em fatores como idade, sexo e atitudes em relação à tecnologia. Os pesquisadores descobriram que os participantes mais velhos eram mais propensos a acreditar que uma imagem gerada por IA foi criada por um ser humano.

“Acho que ninguém já descobriu isso antes, mas não sabemos exatamente como interpretá-lo”, disse a autora do estudo Simone Grassini, psicóloga da Universidade de Bergen, na Noruega, ao The Daily Beast.

Embora haja uma falta de pesquisas gerais sobre as percepções das pessoas sobre o conteúdo gerado por IA, os pesquisadores encontraram resultados semelhantes para o áudio gerado por IA. No ano passado, o professor da Universidade de Toronto, Björn Hellmann, relatou que os indivíduos mais velhos eram menos capazes de distinguir entre a fala gerada por humanos e a fala gerada por IA do que os indivíduos mais jovens.

O objetivo do experimento era determinar se a voz da IA poderia ser usada para estudar como os idosos percebem os sons no ruído de fundo, por isso foi “realmente inesperado”.

todo, Grassini acredita que todos os tipos de mídia gerada por IA, incluindo áudio, vídeo e imagens estáticas, poderiam enganar mais facilmente o público mais velho por meio de um “efeito geral” mais amplo.ambos Harman e Grassini dizem que as gerações mais velhas podem não aprender sobre as características do conteúdo gerado por IA e podem encontrá-lo com menos frequência na sua vida quotidiana, deixando-as mais vulneráveis quando esse conteúdo aparece nos seus ecrãs. Embora o declínio cognitivo e a perda auditiva (para a fala) possam estar em jogo, Grassini ainda observou efeitos em pessoas entre 40 e 50 anos.

Além disso, acrescentou Grassini, os jovens cresceram numa era de desinformação online e estão habituados a fotos e vídeos manipulados. “Vivemos em uma sociedade onde há sempre mais falsificações.”

Como ajudar amigos e parentes a encontrar seu bot

Com tanto conteúdo falso online, pode ser difícil identificá-lo, mas as pessoas mais velhas geralmente têm uma imagem mais clara. Na verdade, eles podem estar mais conscientes dos perigos dos conteúdos alimentados por IA do que as gerações mais jovens.

Uma pesquisa MITRE-Harris de 2023 com mais de 2.000 pessoas descobriu que os baby boomers e os participantes da Geração X estavam mais preocupados com o impacto dos deepfakes do que os participantes da Geração Z e da Geração Y. Isso foi demonstrado. Entre os entrevistados mais velhos, uma percentagem mais elevada de participantes apelou à regulamentação da tecnologia de IA e a mais investimento da indústria de alta tecnologia para proteger o público.

A investigação também demonstrou que as pessoas mais velhas podem ser capazes de distinguir entre manchetes e artigos falsos com mais precisão do que as pessoas mais jovens, ou pelo menos a uma taxa semelhante. As pessoas mais velhas também tendem a consumir mais notícias do que as gerações mais jovens e podem ter acumulado mais conhecimento sobre determinados assuntos ao longo da vida, o que as torna mais difíceis de serem enganadas.

“O contexto do conteúdo é muito importante”, disse Andrea Hickerson, reitora da Escola de Jornalismo e Novas Mídias da Universidade do Mississippi, que pesquisou ataques cibernéticos a adultos mais velhos e detecção de deepfake, ao The Daily Beast. “Se for um assunto sobre o qual qualquer pessoa, sênior ou não, possa saber muito, isso lhes dá a capacidade de visualizar essas informações.”

De qualquer forma, os golpistas têm como alvo os adultos mais velhos com ferramentas generativas de IA cada vez mais sofisticadas. Eles podem usar áudio e imagens deepfake provenientes de mídias sociais para se passar por um neto ligando da prisão pedindo dinheiro para fiança ou até mesmo disfarçar a aparência de um parente em uma videochamada.

Vídeos, áudios e imagens falsos também podem influenciar os eleitores mais velhos antes das eleições. Isto pode ser particularmente prejudicial, uma vez que as pessoas com mais de 50 anos tendem a constituir a maioria do eleitorado geral dos EUA.

Para ajudar os idosos em nossas vidas, Hickerson disse que é importante divulgar a IA generativa e os riscos que ela pode criar online. Comece educando-se sobre os sinais reveladores de uma imagem falsa, como texturas muito lisas, dentes que parecem estranhos ou padrões que se repetem perfeitamente no fundo.

Ela acrescentou que isso pode esclarecer o que sabemos e o que não sabemos sobre algoritmos de mídia social e como atingir os adultos mais velhos. Também é útil esclarecer que a desinformação pode vir de amigos e entes queridos. “Precisamos convencer as pessoas de que não há problema em confiar na tia Betty e não no conteúdo da tia Betty”, diz ela.

ninguém está seguro

Mas à medida que os deepfakes e outras criações de IA se tornam mais sofisticados a cada dia, pode ser difícil até mesmo para os especialistas em tecnologia mais experientes diferenciá-los. Mesmo se você achar que tem um conhecimento especial, esses modelos já podem ser intrigantes. O site This People Does Not Exist oferece fotos horríveis e convincentes de rostos falsos de IA que não necessariamente apresentam traços sutis de suas origens computacionais.

Pesquisadores e empresas de tecnologia criaram algoritmos para detectar automaticamente mídias falsas, mas eles não conseguem funcionar com 100% de precisão. Os modelos de IA generativos em rápida evolução acabarão por superá-los. (Midjourney, por exemplo, lutou por muito tempo para criar mãos realistas até ficar mais inteligente. Com uma nova versão lançada na primavera passada. )

A regulamentação e a responsabilidade corporativa são fundamentais para combater a onda crescente de conteúdo falso invisível e o seu impacto social, disse Hickerson. Na semana passada, mais de 50 projetos de lei foram apresentados em 30 estados com o objetivo de reprimir os riscos de deepfakes. E desde o início de 2024, o Congresso apresentou uma enxurrada de projetos de lei para tratar dos deepfakes.

“É realmente uma questão de regulamentação e responsabilidade”, disse Hickerson. “Precisamos falar sobre isso mais publicamente, incluindo todas as gerações.”