Créditos da imagem: crianças tímidas

A ferramenta de geração de vídeo da OpenAI, Sora, impressionou a comunidade de IA em fevereiro com vídeos suaves e realistas que pareciam muito à frente de seus concorrentes. Mas a estreia cuidadosamente encenada deixou de fora muitos detalhes. Os detalhes foram preenchidos por um cineasta que teve acesso antecipado para criar um curta usando Sora.

Shy Kids é uma equipe de produção digital com sede em Toronto que foi selecionada pela OpenAI como uma das poucas equipes a criar um curta-metragem essencialmente para fins promocionais para OpenAI, mas eles tiveram muito trabalho a fazer quando se tratou de fazer “Air Cabeça.” A liberdade criativa foi dada. Em entrevista ao canal de notícias de efeitos visuais FXguide, o artista de pós-produção Patrick Cederberg disse que está “atualmente usando Sora” como parte de seu trabalho.

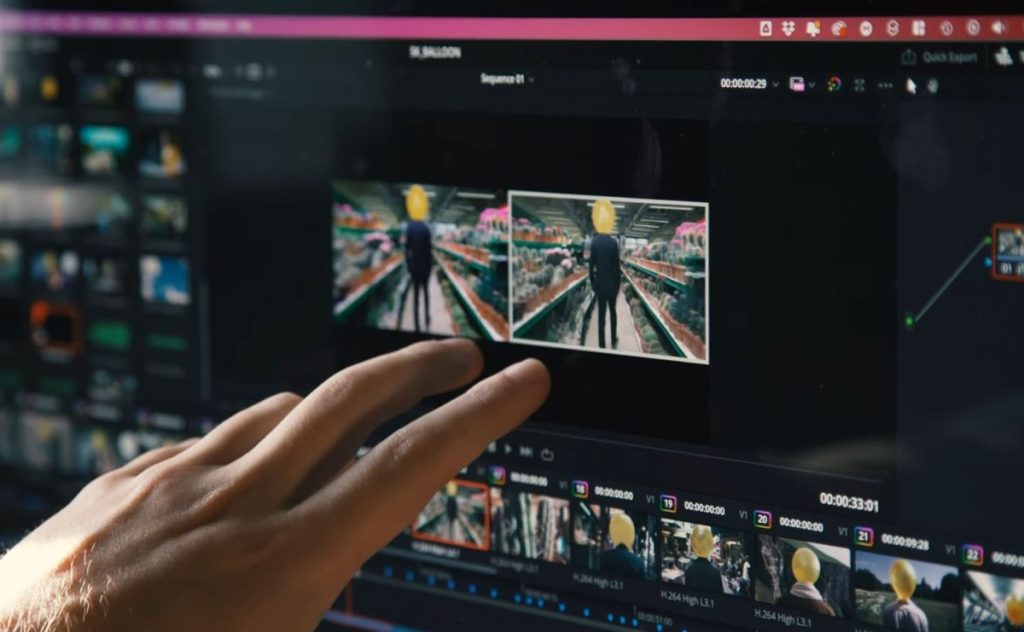

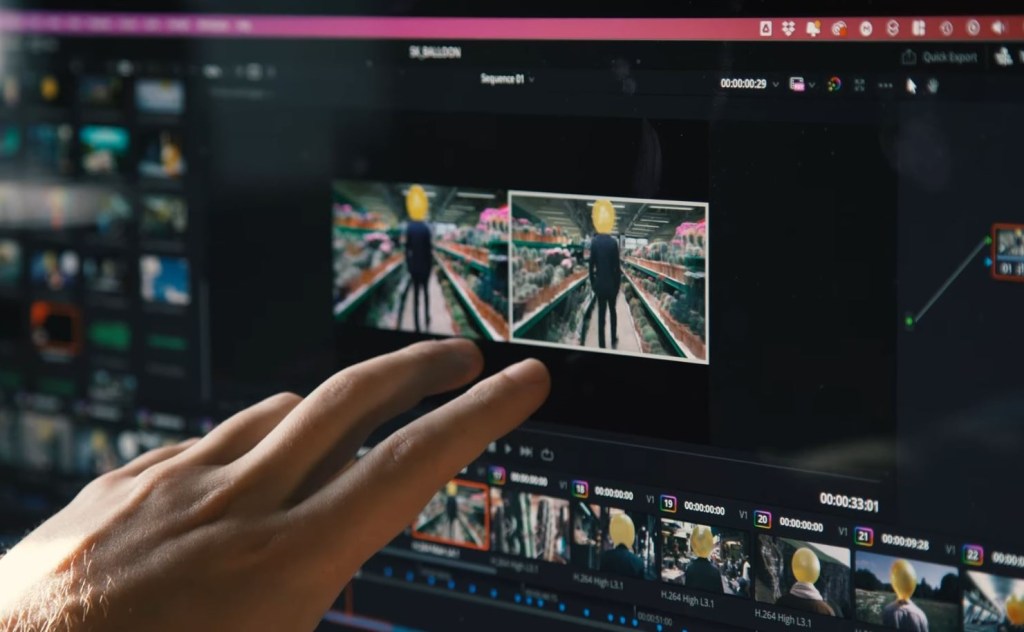

Talvez o ponto mais importante para a maioria das pessoas seja simplesmente este. As postagens da OpenAI destacando os contos levam os leitores a acreditar que eles são mais ou menos totalmente formados a partir de Sora, quando na realidade são feitos com storyboard robusto, edição, correção de cores, rotoscopia e efeitos visuais. Assim como a Apple diz “filmado em um iPhone”, mas não mostra a configuração do estúdio, a iluminação profissional ou o trabalho de cores após o fato, a postagem de Sora mostra que não é assim que as pessoas realmente filmam. isto.

A entrevista de Cederberg é interessante e nada técnica, então se você estiver interessado, acesse fxguide e leia. Mas algumas coisas interessantes sobre o uso do Sora indicam que, embora este modelo seja impressionante, provavelmente não é um avanço tão grande quanto pensamos.

Neste momento, o controlo continua a ser o mais desejável e o mais evasivo. …O mais próximo que conseguimos foi ser muito descritivo com as instruções. Descrever o guarda-roupa e os tipos de balões do personagem foi uma forma de evitar inconsistências. Porque ainda não estabelecemos o conjunto de recursos para controlar totalmente a consistência de cena a cena, de geração em geração.

Em outras palavras, mesmo problemas simples no cinema tradicional, como escolher a cor da roupa de um personagem, exigem soluções alternativas e verificações elaboradas no sistema de produção, já que cada cena é criada independentemente das outras. Obviamente isso poderia mudar, mas certamente dá muito mais trabalho no momento.

A produção de Sora também precisava ser monitorada em busca de elementos desnecessários. Cederberg descreveu como o modelo gerava periodicamente um rosto no balão, seja como um barbante pendurado na cabeça do personagem principal ou na frente dele. Se você não fosse solicitado a excluí-los, teria que removê-los mais tarde, o que também era um processo demorado.

O tempo e o movimento precisos de personagens e câmeras são praticamente impossíveis. “Com a geração atual, você tem um pouco de controle temporal sobre onde essas diferentes ações ocorrem, mas não é preciso… é uma espécie de tiro no escuro”, disse ele em Cederberg.

Por exemplo, o tempo de gestos semelhantes a ondas é um processo altamente aproximado e orientado por sugestões, diferentemente da animação manual. E tomadas como aquelas que se movem para cima sobre o corpo de um personagem podem ou não refletir os desejos do cineasta. Portanto, neste caso, a equipe renderizou a cena composta na orientação retrato e realizou um recorte panorâmico na postagem. Os clipes resultantes geralmente ficavam em câmera lenta sem nenhum motivo específico.

Um exemplo de foto de Sora e como ficou curta. Créditos da imagem: crianças tímidas

Na verdade, Cederberg disse que o uso de termos cotidianos no cinema, como “pan right” e “tracking shot”, é geralmente contraditório, e que a equipe achou isso bastante surpreendente.

“Os pesquisadores não pensavam como os cineastas antes de abordarem os artistas para brincarem com essa ferramenta”, diz ele.

Como resultado, a equipe executou centenas de gerações, cada uma com duração de 10 a 20 segundos, mas acabou usando apenas algumas. Cederberg estimou a proporção em 300:1, o que provavelmente surpreenderia qualquer um em filmagens normais.

Na verdade, a equipe criou um vídeo dos bastidores explicando alguns dos problemas encontrados. Por favor, dê uma olhada se você estiver interessado. Tal como acontece com muitos conteúdos relacionados com IA, os comentários são bastante críticos em relação ao esforço como um todo, mas não tão difamatórios como a publicidade assistida por IA recentemente exposta.

Um último ponto interessante diz respeito aos direitos de autor. Se você pedir a Sora para lhe dar um clipe de Star Wars, ele recusará. E mesmo se você tentar contornar isso com “um cara vestido com uma espada laser em uma nave espacial retro-futurista”, isso também será rejeitado porque algum mecanismo reconhecerá o que você está tentando fazer. Ele também se recusou a fazer “fotos no estilo Aronofsky” ou “zooms Hitchcockianos”.

Por um lado, faz todo o sentido. Mas isso levanta a questão. Se Sora sabe o que são, isso significa que o modelo foi treinado nesse conteúdo e é melhor saber que está infringindo. Mantenho meu cartão de dados de treinamento bem guardado? Entrevista com a CTO Mira Murati e Joanna Stern – quase certamente não nos dirá.

Quando se trata de Sora e seu uso na produção cinematográfica, fica claro que Sora é uma ferramenta poderosa e útil, mas seu papel não é “fazer filmes com perfeição”. ainda. Como outro vilão disse certa vez: “Vem mais tarde”.